Entre l’humain et la machine, à qui faisons-nous confiance?

Les technologies numériques et l’intelligence artificielle s’intègrent de plus en plus dans notre quotidien et elles ont un grand impact sur notre manière de travailler et de prendre des décisions. Si ces outils promettent d’être efficaces, rapides et précis, ils ne sont pas sans risques.

Qu’est-ce que le biais d’automatisation?

Le biais d’automatisation peut être défini comme la tendance à privilégier les recommandations ou les décisions générées par une intelligence artificielle (IA), même lorsque celles-ci sont basées sur des fausses informations. Autrement dit, lorsqu’une IA nous fournit une réponse, on a naturellement tendance à la considérer comme plus fiable que notre propre analyse ou que celle d’un autre humain [1].

Ce biais repose sur l’idée que les machines seraient objectives, neutres et plus performantes que nous. Pourtant, les systèmes automatisés sont conçus par des humains et entraînés sur des données parfois biaisées!

Plusieurs facteurs expliquent la présence du biais d’automatisation. D’abord, la complexité technologique joue un rôle majeur. Le processus derrière la création d’une IA est complexe et on a donc tendance à s’en remettre aveuglément à leurs résultats, à défaut de pouvoir les vérifier et les comprendre.

Ensuite, il y a aussi le fait que les environnement de travail mettent parfois de la pression et demande à leurs équipes de travail d’être très performantes. Dans ces contextes, les outils automatisés sont présentés comme des aides à la décision permettant de gagner du temps. Remettre en question leurs recommandations peut sembler contre-productif, voire inutile.

Enfin, l’autorité perçue de la technologie renforce ce biais. Un algorithme sophistiqué ou une IA avancée inspire souvent plus de confiance qu’un jugement humain, même lorsque ce dernier est fondé sur l’expérience et des données fiables.

Les risques associés à ce biais

Je m’inquiète face à l’utilisation excessive de l’IA. Je me questionne même parfois sur les effets que cela pourrait avoir sur notre cerveau, nos réflexions, notre créativité et même notre autonomie.

Mais je ne suis pas la seule à être inquiète puisqu’une étude du MIT arrive à des conclusions assez troublantes. On a demandé à des personnes (18 à 39 ans) d’écrire un texte sur un sujet général. Les personnes participantes étaient divisées en trois groupes. Un qui n’avait pas le droit d’utiliser les outils technologiques, l’autre qui pouvait se servir seulement du moteur de recherche Google et le dernier avait accès à ChatGPT.

La recherche démontre que l’activité cérébrale du dernier groupe était vraiment plus faible que celle des deux autres groupes. Aussi, 4 personnes sur 5 (83 %) n’arrivaient pas à se remémorer une seule phrase quelques minutes après avoir terminé la rédaction [2]. Le pire, selon moi, c’est que les textes se ressemblaient énormément et manquaient d’originalité…

De plus, ce biais peut conduire à une déresponsabilisation. Si une décision est prise sur la base d’un système automatisé, il devient plus facile de rejeter la faute sur la technologie en cas de problème, plutôt que d’assumer sa responsabilité.

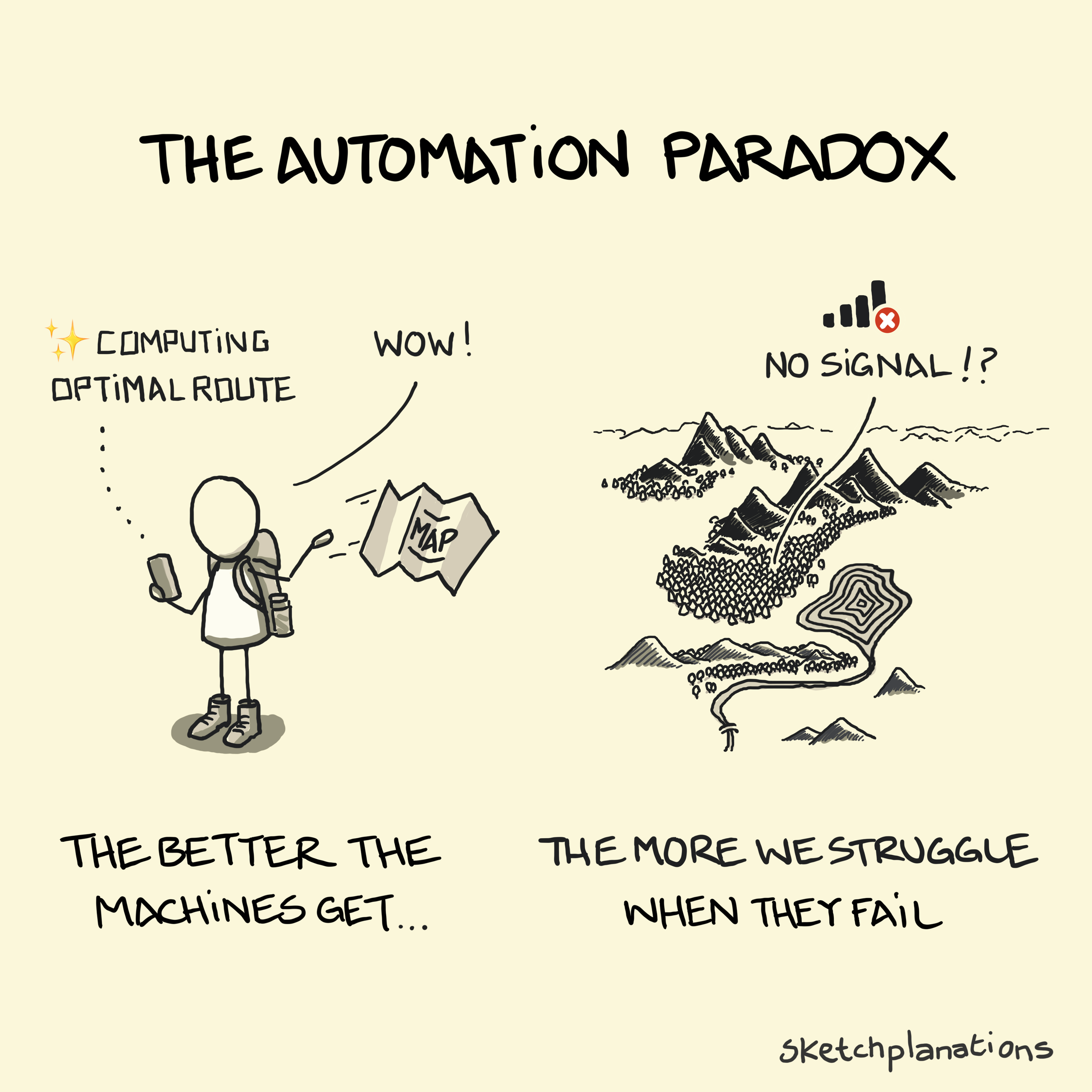

Le fait de toujours déléguer nos tâches à l’IA ou aux autres outils technologiques peut augmenter notre dépendance à leur utilisation.

Comment limiter le biais d’automatisation?

Réduire l’impact du biais d’automatisation ne veut pas nécessairement dire de renoncer à la technologie, mais d’apprendre à mieux l’utiliser. La formation des personnes utilisatrices est nécessaire afin qu’elles comprennent leurs limites et qu’elles sachent interpréter les réponses de l’IA avec discernement. Le biais d’automatisation est un bon exemple du fait que la technologie n’est jamais infaillible et que la valeur du jugement humain demeure importante.

À bientôt!

Sarah

Références :

[1]: Gratton, C. (2020). Biais d’automatisation. Dans E. Gagnon-St-Pierre, C. Gratton & E. Muszynski (Eds). Raccourcis : Guide pratique des biais cognitifs Vol. 2. En ligne : www.shortcogs.com